Google AI спутал черепаху с винтовкой. Почему это опасно?

Независимые разработчики Labsix показали, насколько легко ошибиться системе компьютерного зрения. От охранных систем до автомобилей общество постепенно привыкает доверять AI и нейронным сетям больше, чем собственным глазам. Но достойны ли они этой ответственности сегодня?

Игрушечная черепаха на этом видео, по мнению Google AI, больше похожа на двустволку. Это так называемый adversarial image, или оптическая иллюзия для систем компьютерного зрения. Люди не заметят подвоха, но паттерн на черепахе неизменно распознается системой как оружие.

Пока это значит, что автопилот в машине можно будет обмануть дорожным знаком, который будет выглядеть для людей нормально, но определится автомобилем как, например, внезапно появившийся пешеход.

Такие изображения важно изучать, потому что работа нейронных сетей решает все больше повседневных задач и мы не должны позволить им ошибаться так, как это свойственно людям.

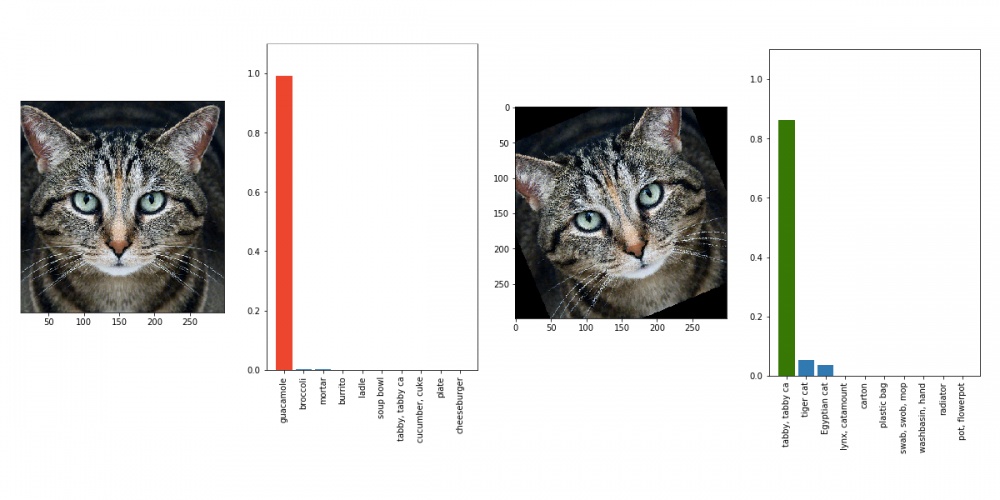

Разработчики тестировали свою «атаку» на алгоритме Google Inception-v3. Компания Google позволяет тестировать систему всем. Пока это не коммерческая версия, но очень близка к ней.

Разница между гуакамоле и котом - в небольшом повороте изображения. У Google есть варианты решения этой проблемы - картинку нужно повернуть на небольшой угол.

Впрочем, исследователям нужен был доступ к пониманию работы алгоритма, и он у них был. В реальной жизни это значительная преграда, сторонний пользователь не может получить доступ к ПО проезжающих мимо машин и их системе распознавания образов.

Такие атаки - большая опасность для людей. Но они эффективны только при определенном стечении обстоятельств. Такой пример показывает, насколько хрупкими пока являются системы компьютерного зрения. И если мы не разберемся с ними сейчас, они определенно приведут к проблемам в будущем.